美國的生命未來研究所 (FLI, Future of Life Institute ) 是一家致力於促進人工智慧安全和可持續發展的非營利組織。2017 年 1 月 5 日至 8 日,由生命未來研究所在美國加利福尼亞州阿西洛瑪(Asilomar)會議場地,舉辦阿西洛瑪有益人工智慧會議。共計上百位經濟學、法律、倫理學和哲學領域的思想領袖和研究人員齊聚一堂,討論和制定有益人工智慧的原則,達成一套人工智慧研究指引,隨後發表一份人工智慧原則草案,稱為《人工智慧原則》,共計列舉出來 23 條原則,涵蓋人工智慧開發、使用和管理的各個面向。

註:此文並未涵蓋該報告全部事項,相關內容務須參閱各項文獻原本及最新版次。此處係閱讀隨筆,僅供個人學習,非供印刷或潛在意圖出版。

隨著資訊產業人工智慧的發展日行千里,提供一些對於社會及公民營產業界相當有益的工具,從而受到全世界的各個層面廣泛使用。 生命未來研究所認為,若以此文件推薦原則用於經營和開發人工智慧指引,預期人工智慧持續發展,將於未來幾十年甚至數個世紀,創造更多機會以更有效地幫助和壯大人類。此等原則係澄清人工智慧原則如何適用於不同類型的人工智慧系統。並提供更具體的指導策略,以供國際及國家、公民營產業、研究及教育等各行各業實施人工智慧原則。

關於研究的內容

1)研究目標:人工智慧研究的目標須引起有益的智慧,而不是未經引導的智慧。

2)研究資助:投資人工智慧的同時,須資助那些確保其創造有益價值的研究,包括計算機科學、經濟學,法學,倫理和社會研究的棘手問題,諸如:

- 吾人如何使得未來人工智慧系統極為強固,從而按照吾人意志行事而不會發生故障或被駭客侵入?

- 如何通過自動化提高吾人繁榮的同時,維護人民的資源和意向?

- 吾人該如何更新法律系統,使其更為公平和有效,緊隨人工智慧發展步伐,並管理人工智慧相關風險事項?

- 人工智慧應該遵循哪些價值組合?它應該具有什麼樣的法律和倫理地位 ?

3) 科學與政策連結:人工智慧研究人員和政策制定者之間,應形成積極、有建設性的交流。

4) 研究文化:研究人員和人工智慧開發人員應該培養一種互相合作、互相信任和互相透明的文化。

5) 規避攀比:人工智慧開發團隊間應積極合作,避免以妥協安全標準為相互競爭的代價。

關於倫理和價值觀

6)安全性:人工智慧系統應當在整個運行週期均是安全可靠的,並在適用且可行的情況下可查證其安全性。

7)故障透明:如果一個人工智慧系統引起損害,須有辦法查明原因。

8)司法透明:在司法做出裁決過程,但凡涉及自主系統,須提供一個有說服力的解釋,並由一個有能力足以勝任的權責人類得以稽核。

9)責任:先進人工智慧系統的設計者和建設者是系統利用、濫用和行動的利害關係人,他們有責任和機會塑造道德關聯事項。

10)價值一致:對於高度自主人工智慧系統的設計,須確保其目標和行為在整個運行過程中與人類價值相一致。

11)人類價值:人工智慧系統的設計和運作須符合人類對尊嚴、權利、自由和文化多樣性的理想。

12)個人隱私:既然人工智慧系統能分析和利用資料,人們須有權利獲取,管理和控制他們產生的資料。

13)自由與隱私:人工智慧對個人資料的應用不能不合理地削減人們的實際或感知的自由。

14)共享利益:人工智慧技術應使盡可能多地人受益和賦能。

15)共享繁榮:人工智慧創造的經濟繁榮應該廣泛的共享,造福全人類。

16)人類控制:為實現人為目標,人類應該選擇如何以及是否由人工智慧代為做出決策。

17)非顛覆:通過控制先進的人工智慧系統所賦予的權力,應尊重和改善健康社會所基於依賴的社會和公民進程,而不是顛覆此等基本價值。

18)人工智慧軍備競賽:須避免致命自主式武器的軍備競賽。

關於長期問題

19) 能力警示:因為尚未達成共識,我們應該避免對未來人工智慧性能上限做出強烈的假設。

20) 重要性:先進人工智慧可代表地球上生命歷程的深遠變化,須投注相應的關注和資源進行規劃和管理。

21) 風險:對於人工智慧系統帶來的風險,尤其是那些災難性和存在性的風險,必須付出與其預期衝擊相稱的努力,進行規劃和緩解風險。

22) 反覆地自我完善:旨在以可能導致品質或數量迅速增加而反覆地自我改進和自我複製的人工智慧系統,必須受到嚴格的安全管制措施予以約束。

23) 共同善:超級智慧的發展只宜服務於廣大共享倫理理想,造福於全人類,而不是為了某個國家或某個組織的利益。

成就

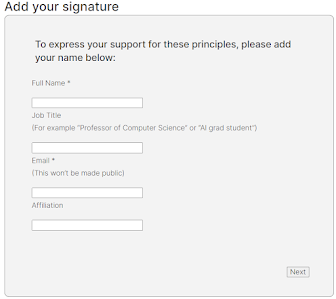

上述原則由2017年8月11日迄至今日,已獲得5720位相關產業界人士簽署贊同。

簽署頁面。

- 此等原則的發表促進了國際社會對人工智慧原則與倫理的討論。

- 該等原則被多個國家和組織採納,成為人工智慧發展的參考文件。

- 該等原則在推動人工智慧的負責任發展方面發揮了積極作用。

原則建議:

- 澄清人工智慧原則如何適用於不同類型的人工智慧系統。

- 提供更具體的指導策略,以實施人工智慧原則。

- 生命未來研究所(FLI)建議增加一個原則:強調人工智慧應對氣候變化和其他全球挑戰做出貢獻。

優勢及優點:

- 該等明確的人工智慧(AI)原則着眼於促進倫理,建立有益智慧,涵蓋了人工智慧開發、使用和管理的各個方面,具有全面性;

- 亦為人工智慧發展和使用提供共同原則架構,另提供明確的目標和指引,具有前瞻性。

- 該等原則有助於制定政策和規範,具有可操作性。

- 從而得到廣泛的支持,包括來自學術界、產業界和政府的領導階層,具有普惠性;

- 提倡資助確保人工智慧創造有益價值的研究,強調了對人類利益的關注,具有人文關懷性。

成就與未來發展:該等原則在促進人工智慧研究與發展的同時,亦為制定國際人工智慧準則建立模範。未來,尚可拓展至更廣泛的國際合作,進一步完善以人為本的人工智慧治理。

缺點、陷阱及不同意見:該等原則缺乏具體可操作性,導致在實際應用中解釋和執行上出現窒礙難行情況。某些批評者認為該等原則過於籠統或不夠具體,尚需進一步細緻化。缺乏具體的指導策略,未能適應各式各樣文化和社會背景的特定需求。實施該等原則仍需國際及社會各階層的努力,仍然存在某些挑戰性前景。

其他資訊:聯合國教育科學及文化組織(UNESCO)等機構提倡人工智慧倫理問題建議書,強調尊重價值和原則,並促進法規和業務準則的修訂,以確保人工智慧的行為與國際標準相一致。生命未來研究所(FLI)的人工智慧原則已被翻譯成 30 多種語言。

原則的行動項目:生命未來研究所(FLI)呼籲各界採取行動,實施人工智慧原則。具體行動包括:

- 教育和提高公民大眾認識與瞭解人工智慧原則。

- 制定和實施法律和政策,促進落實人工智慧原則。

- 建立和支持人工智慧原則的倡議和組織。

總體而言,FLI 的人工智慧原則是一份具有重要意義的文件。它為人工智慧的發展和使用提供了一個共同的架構,有助於確保人工智慧的發展符合人類利益。

詳細內容參見該報告原文。

(竟)

沒有留言:

張貼留言